Was ChatGPT wirklich kann – und was nicht

Zwischen Hype und Realität

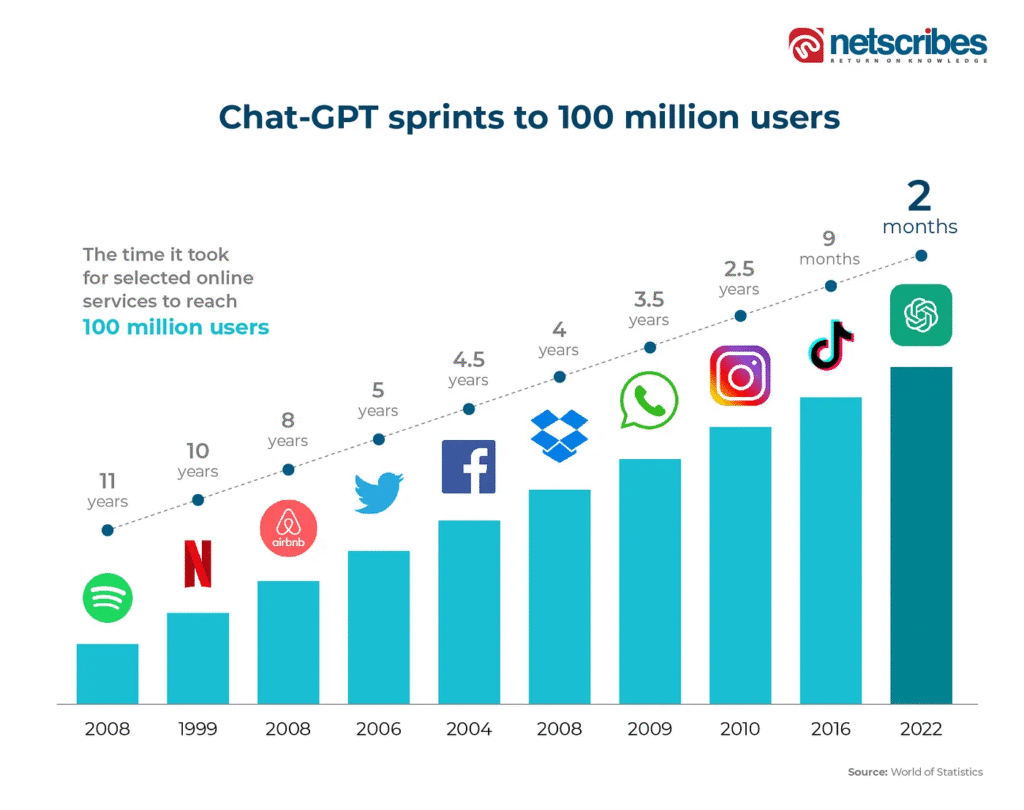

Seit Ende 2022 ist ChatGPT in aller Munde. Bereits zwei Monate nach dem offiziellen Launch erreichte der KI-Chatbot die Marke von 100 Millionen Nutzern weltweit – schneller als jede andere Consumer-App zuvor.

Heute nutzen Millionen von Menschen den KI-Chatbot täglich, sei es zum Schreiben von Texten, Programmieren, Recherchieren oder einfach nur, um sich kreative Ideen geben zu lassen. Manche sprechen von einer Revolution, andere warnen vor überzogenen Erwartungen. Doch je intensiver man mit ChatGPT arbeitet, desto klarer wird: Es gibt enorme Stärken, aber auch klare Grenzen. Der Eindruck, dass wir mit ChatGPT einen „digitalen Allwissenden“ geschaffen haben, ist eine Illusion.

Dieser Artikel geht der Frage nach, was ChatGPT tatsächlich leisten kann, wo es scheitert, welche Quellen seine Antworten dominieren und wie sich die Technologie sinnvoll im Alltag und Beruf einsetzen lässt. Ziel ist eine nüchterne, praxisnahe Analyse, die dabei hilft, ChatGPT besser einzuordnen und das Maximum daraus herauszuholen.

Was ChatGPT eigentlich ist

Um die Stärken und Schwächen zu verstehen, muss man zunächst klären, was ChatGPT ist – und was nicht. ChatGPT basiert auf den GPT-Modellen von OpenAI. GPT steht für „Generative Pre-trained Transformer“. Vereinfacht gesagt, wurde das Modell mit riesigen Mengen an Texten trainiert, darunter Bücher, Artikel, Forenbeiträge und Webseiten. Es arbeitet nicht mit „Wissen“, sondern mit Wahrscheinlichkeiten. ChatGPT berechnet, welches Wort am wahrscheinlichsten als Nächstes kommt.

Es versteht Inhalte nicht im menschlichen Sinne, sondern ahmt Sprache nach. Deshalb ist es wichtig: ChatGPT ist kein Professor, kein Orakel und kein Mensch mit Bewusstsein. Es ist ein hochentwickelter Sprachgenerator, der in vielen Fällen verblüffend gut funktioniert, aber nicht unfehlbar ist.

Woher ChatGPT seine Informationen hat

Viele Nutzer stellen sich die Frage, woher ChatGPT all das weiß. Die kurze Antwort lautet: ChatGPT zieht nicht live Daten aus dem Internet, sondern basiert auf Trainingsdaten bis etwa 2023 oder 2024. Neue Ereignisse kennt das Modell nur, wenn OpenAI ein Update einspielt oder man eine Version mit Webzugriff nutzt.

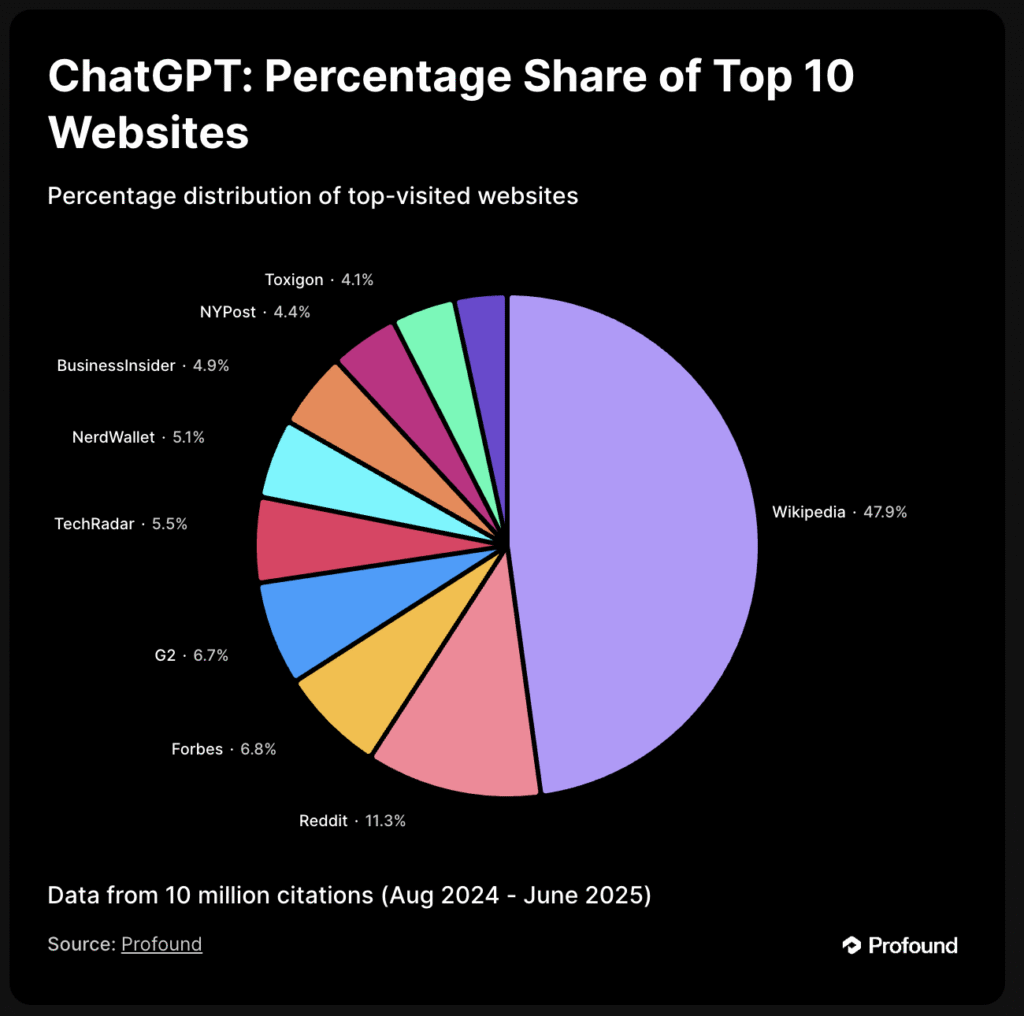

Eine Analyse von Profound hat untersucht, welche Webseiten am häufigsten in Antworten von ChatGPT zitiert werden. Grundlage waren 10 Millionen Zitate zwischen August 2024 und Juni 2025. Das Ergebnis ist eindeutig: Fast 50 Prozent der Informationen stammen von Wikipedia. An zweiter Stelle folgt Reddit mit 11,3 Prozent. Danach kommen bekannte Tech- und Finanzseiten wie Forbes mit 6,8 Prozent, G2 mit 6,7 Prozent, TechRadar mit 5,5 Prozent, NerdWallet mit 5,1 Prozent, BusinessInsider mit 4,9 Prozent sowie Medien wie die New York Post mit 4,4 Prozent.

Die Daten zeigen, dass Wikipedia die dominante Quelle ist, was erklärt, warum ChatGPT häufig faktennah wirkt, aber manchmal auch oberflächlich bleibt. Reddit liefert praxisnahe Beispiele und Diskussionen, bringt aber auch subjektive Meinungen und Verzerrungen mit. Business- und Techseiten wie Forbes, BusinessInsider oder TechRadar verleihen den Antworten eine wirtschaftliche und technologische Perspektive. Insgesamt ergibt sich eine Mischung aus Enzyklopädie und Diskussionsforum, was die Stärken und Schwächen der Antworten erklärt.

Was ChatGPT wirklich kann

Die grösste Stärke von ChatGPT liegt in der Generierung von Texten. Egal ob Blogartikel, E-Mail, Bewerbungsschreiben oder Social-Media-Post – in Sekunden entstehen Texte, die grammatikalisch korrekt und stilistisch flexibel sind. Ein Text, für den ein Mensch zwei Stunden braucht, entsteht mit ChatGPT in wenigen Minuten.

Auch in der Programmierung zeigt sich die Leistungsfähigkeit. Entwickler nutzen ChatGPT, um Code-Snippets in Python, SQL, JavaScript oder Java zu erstellen. Es erklärt komplexe Funktionen in einfacher Sprache und hilft beim Debugging, indem es auf Fehler hinweist. Es ersetzt keinen Senior Developer, wirkt aber wie ein extrem schneller Tutor, der beim Lösen alltäglicher Probleme unterstützt.

Darüber hinaus eignet sich ChatGPT hervorragend für Brainstorming und kreative Prozesse. Ob Kampagnenideen, Produktnamen oder Content-Strategien – die KI liefert eine Vielzahl an Vorschlägen, die als Ausgangsbasis dienen können. Es handelt sich nicht um echte Kreativität, aber um einen wirksamen Katalysator, der Denkprozesse beschleunigt.

Ein weiteres starkes Feld ist die Sprachunterstützung. ChatGPT übersetzt Texte in über 50 Sprachen, passt den Stil an unterschiedliche Zielgruppen an und hilft internationalen Teams, effizient zu kommunizieren.

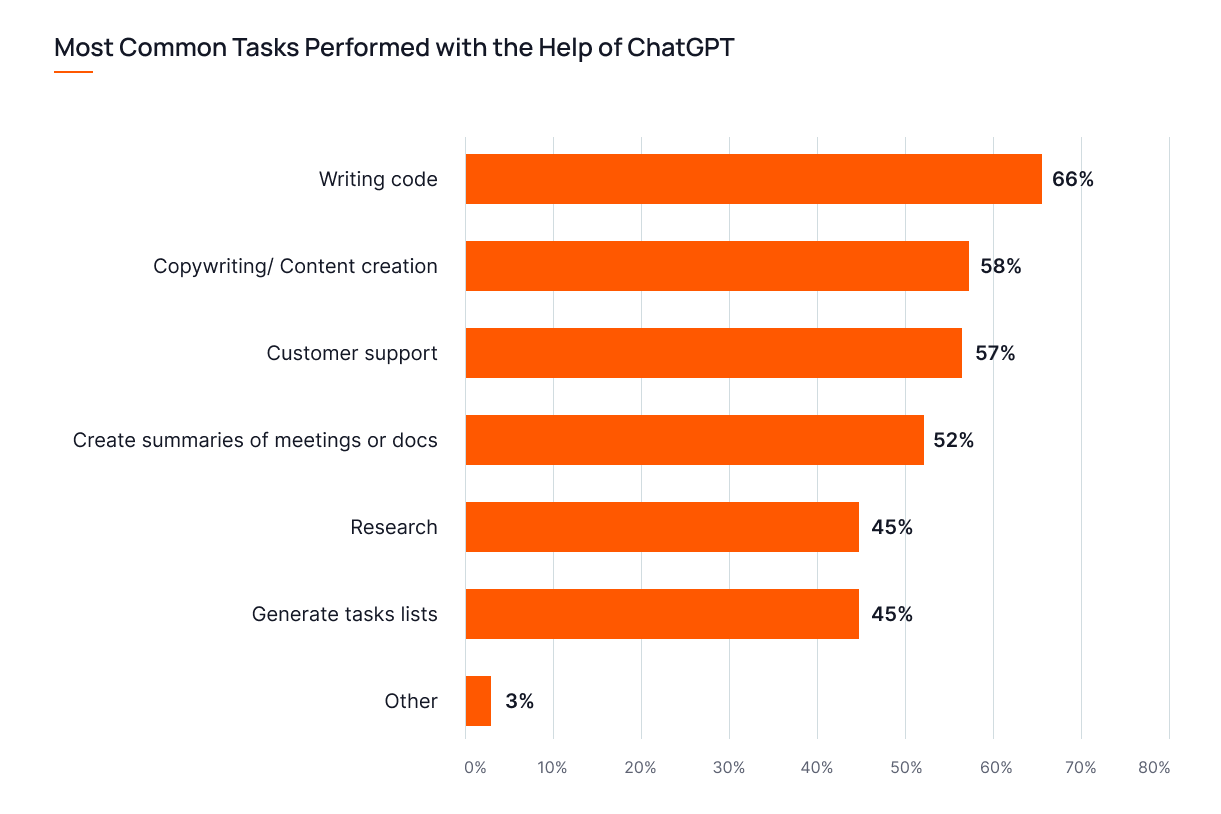

Umfragedaten aus den USA zeigen, dass ChatGPT für besonders vielfältige Aufgaben genutzt wird. Neben typischen Anwendungen wie „Lernen“ oder „Inhaltserstellung“ zählen auch „Coding/Programmierung“, „Entertainment“ sowie „Alltagsfragen (z. B. Gesundheit, Hobby)“ zu den häufigsten Einsatzzwecken. Diese Verteilung macht deutlich, dass ChatGPT längst weit mehr als nur ein Schreibtool ist – es ist ein Alltagsbegleiter, der in unterschiedlichsten Bereichen praktische Unterstützung leistet.

Wo ChatGPT (momentan noch) scheitert

So beeindruckend die Ergebnisse sind, so deutlich treten die Schwächen zutage. Eine der grössten Herausforderungen ist das Phänomen der Halluzination. Dabei erfindet ChatGPT Fakten, Zitate oder sogar ganze Studien, wenn keine passenden Informationen vorhanden sind. Die Antworten klingen plausibel, sind aber schlicht falsch. IT-P erklärt in einem Blogbeitrag sehr anschaulich, wie diese Halluzinationen entstehen und warum sie gefährlich sind. Das Problem liegt darin, dass ChatGPT in seiner sprachlichen Überzeugungskraft so glaubwürdig wirkt, dass viele Nutzer erfundene Informationen für wahr halten.

Ein weiteres Problem ist, dass ChatGPT kein echtes Verständnis hat. Es weiss nicht, wovon es spricht, sondern erkennt lediglich Muster und produziert Texte. Logisches Denken, wie es Menschen beherrschen, fehlt. Dies wird besonders deutlich bei komplexen Fragestellungen, die über reine Sprache hinausgehen.

Auch Verzerrungen spielen eine Rolle. Da ChatGPT stark auf Wikipedia und Reddit basiert, übernehmen die Antworten deren Vorurteile und kulturelle Schlagseiten. Politische Schlagseiten oder einseitige Sichtweisen sind keine Seltenheit.

Schliesslich darf man nicht vergessen, dass ChatGPT in seiner Standardversion ohne Webzugriff blind für aktuelle Entwicklungen ist. Fragt man nach Börsenkursen oder den neuesten iPhone-Features, erhält man veraltete Informationen. Seit Mai 2025 gibt es jedoch die neue Funktion »Deep-Research-Connector«, mit der ChatGPT gezielt auf aktuelle externe Quellen zugreifen kann. Je nach Anbindung lassen sich Inhalte aus Dropbox, GitHub, OneDrive, SharePoint oder dem Web nutzen. So können auch eigene Dokumente oder aktuelle Webseiten einbezogen werden, was besonders für Fachrecherchen, Projektarbeit oder datenbasierte Analysen hilfreich ist. Seit Februar 2025 ist diese Funktion auch für Pro-Nutzer in der Schweiz verfügbar. Pro-Abonnenten erhalten bis zu 250 Anfragen pro Monat, während Plus-, Team- und Enterprise-Nutzer ebenfalls Zugang haben, allerdings mit einem kleineren Kontingent von etwa 25 Anfragen. Free-Nutzer erhalten eine begrenzte Anzahl von fünf „Lightweight“-Abfragen.

Chancen und Risiken im Business

Die Chancen liegen auf der Hand. Mitarbeiter können mit ChatGPT enorm viel Zeit sparen, Routineaufgaben lassen sich schneller erledigen und die Content-Produktion skalieren. Ganze Geschäftsmodelle, wie AI-gestützte Beratung oder automatisierte Recherche, entstehen neu.

Doch die Risiken sind ebenso real. Fehlinformationen durch Halluzinationen können zu falschen Entscheidungen führen. Datenschutzprobleme entstehen, wenn vertrauliche Unternehmensdaten in ChatGPT eingegeben werden. Und es besteht die Gefahr einer Abhängigkeit: Wer sich zu stark auf ChatGPT verlässt, riskiert, dass Mitarbeiter verlernen, kritisch zu denken und eigenständig zu recherchieren.

ChatGPT im Kontext von Cybersecurity

Besonders spannend und zugleich beunruhigend ist die Rolle von ChatGPT in der Cybersecurity. Kriminelle nutzen die KI bereits, um Phishing-Mails zu verfassen, die keine Rechtschreibfehler mehr enthalten und damit glaubwürdiger wirken. Auch Social Engineering wird durch Deepfakes auf ein neues Niveau gehoben. Darüber hinaus ist es möglich, mit ChatGPT Schadcode zu generieren oder Skripte zu optimieren – auch wenn die Plattform versucht, solche Nutzungen einzuschränken.

Ein Bericht von Europol warnt ausdrücklich vor diesen Entwicklungen. Die Grenze zwischen nützlicher Automatisierung und missbräuchlicher Nutzung verschwimmt. Damit wird deutlich: KI ist nicht nur eine Chance, sondern auch eine ernsthafte Bedrohung, wenn sie in die falschen Hände gerät.

Wie man ChatGPT richtig einsetzt

Die wichtigste Regel im Umgang mit ChatGPT ist, präzise zu sein. Je genauer die Frage gestellt und je klarer das Ziel formuliert wird, desto besser sind die Ergebnisse. Nutzer sollten die Antworten stets kritisch prüfen, Fakten gegenchecken und Ergebnisse iterativ verbessern lassen.

Eine hilfreiche Metapher lautet: Behandle ChatGPT wie einen hochintelligenten Praktikanten. Es ist schnell, fleißig und kreativ, aber es braucht Führung und Kontrolle. Ohne diese Kontrolle produziert es fehlerhafte oder irreführende Ergebnisse.

Fazit: Die Balance ist entscheidend

ChatGPT ist mächtig, aber nicht magisch. Es ist ein Werkzeug – kein Orakel. Wer versteht, wie es funktioniert, kann enorme Produktivitätsgewinne erzielen, kreative Blockaden überwinden und Prozesse beschleunigen. Wer es blind nutzt, läuft Gefahr, auf Halluzinationen hereinzufallen, falsche Entscheidungen zu treffen oder vertrauliche Daten preiszugeben.

Das Fazit von Bytegeflüster lautet: Nutze ChatGPT als Turbo, aber halte immer selbst die Hände am Steuer.